Sau vài tháng, mình thử nghiệm OpenAI GPT v3.5 (gpt-3.5-turbo) đối với tài liệu khoa học (chủ yếu là kinh tế, và một số nội dung khoa học xã hội khác) thông qua API lập trình (chứ không phải qua giao diện ChatGPT vì không phù hợp để tự động hóa và xử lý nội dung dài).

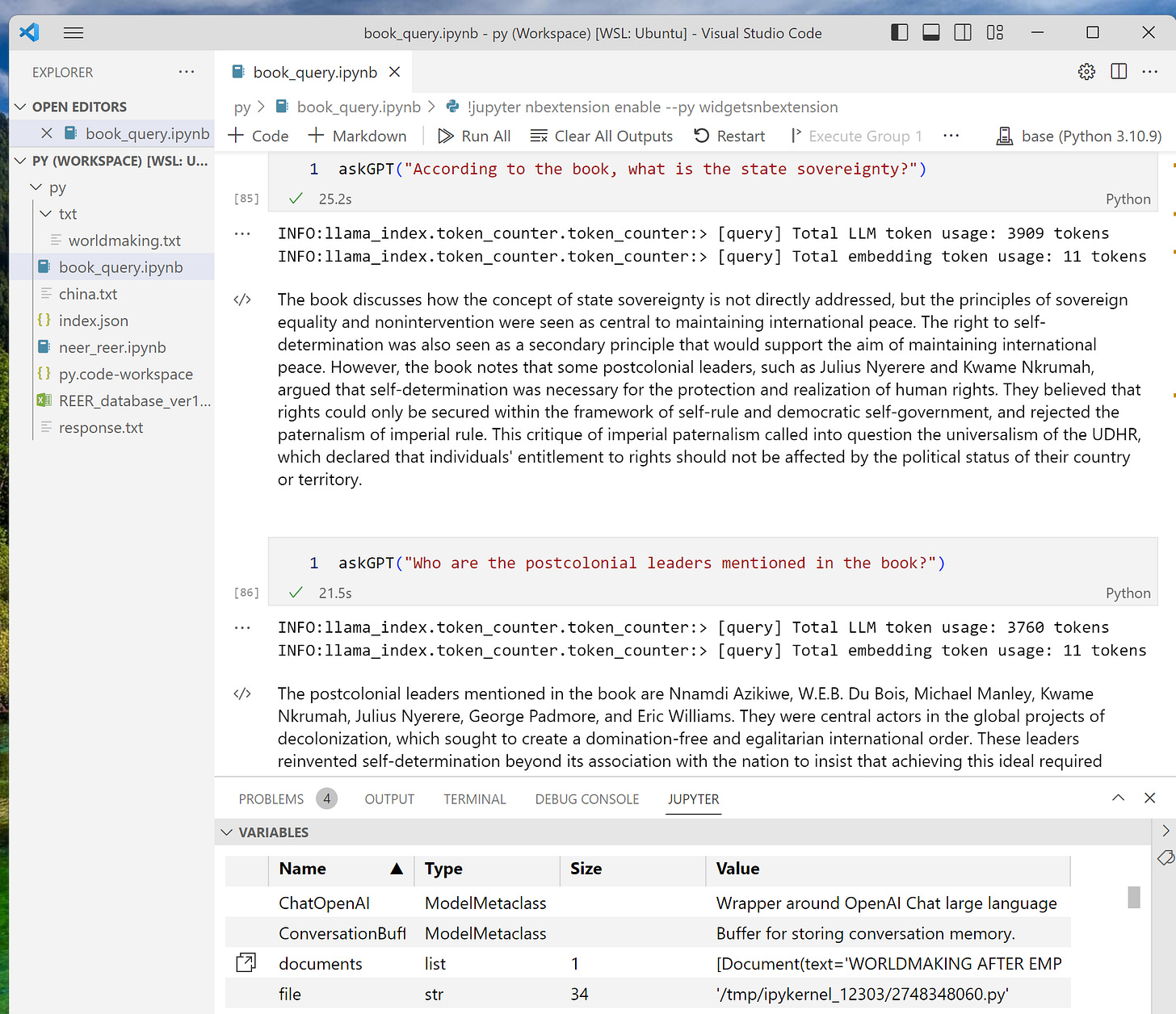

Chẳng hạn, như trong hình, mình đã số hóa khoảng hơn 200 trang của cuốn “Worldmaking after Empire: The Rise and Fall of Self-Determination” (Adom Getachew), và yêu cầu GPT tóm tắt nội dung cuốn sách cho mình. Nó cho ra kết quả tương đối ổn.

Tuy nhiên, khi tương tác với GPT để xử lý tài liệu khoa học kinh tế, mình có một số lưu ý như này:

1/ Luôn luôn “priming” khi đặt câu hỏi, tức là gán cho nó một vai trò. Ví dụ: “Suppose you are a labor economist…” Bằng cách này, ta sẽ "ép" GPT vào một bối cảnh, chuyên môn nhất định, hơn là một câu hỏi chung chung.

GPT, hay Bard không phải là con người. Bạn không nên hỏi nó như kiểu bạn đang hỏi một con người. Thay vì gõ vào nguyên một đoạn văn dài, nên viết prompt theo dạng các câu đơn giản, bao gồm những chỉ dẫn (mệnh lệnh) nhỏ.

Ví dụ: “Giả sử mày là nhà kinh tế học. Phân loại tiêu đề tin tức ‘Fed vẫn muốn nâng lãi suất dù Mỹ có nguy cơ suy thoái nhẹ’ là tin tốt, tin xấu, hay trung lập. Tin tức này là tốt hay xấu cho nền kinh tế Việt Nam trong trung hạn?”

Ở đây, ta có 3 chỉ dẫn: (1) bảo GPT phải đảm nhận một vai trò, (2) yêu cầu GPT dùng sentiment analysis để phân tích dữ liệu đầu vào (tin tức), và (3) khai thác khả năng suy luận của GPT khi tồn tại bối cảnh (1) và kết quả từ (2).

2/ Đối với tài liệu dài, phần danh mục tài liệu tham khảo có thể gây nhiễu kết quả của GPT. Do đó, cần lưu ý.

3/ Không nên đặt các câu hỏi mà chính bản thân mình không thể (hoặc khó có thời gian) để kiểm chứng.

Chẳng hạn, mình có thể hỏi GPT và Bard: “Suggest 5 academic textbooks, including their ISBNs, about the U.S. labor market.” Cả hai vẫn cho ra kết quả nhầm lẫn không ăn nhập giữa tên sách, tên tác giả và ISBN; thậm chí tự sáng tác ra số ISBN.

Đối với sách, ta có thể yêu cầu tóm tắt, hoặc đặt các câu hỏi có tính trích xuất dữ liệu. Tuy nhiên, đối với tài liệu khoa học, nên cẩn thận khi đặt câu hỏi, đặc biệt là liên quan tới research methodologies vì khả năng hiểu ngôn ngữ toán của GPT vẫn chưa ổn định. Kiểu gì rồi mình cũng phải mở phần đó ra để đọc lại xem GPT có trả lời đúng hay không.

Thay vào đó, nên đặt những câu hỏi có tính gợi ý, đại loại như: “Suggest a list of most influential papers on the link between labor cost and price inflation in East Asian economies.”

4/ Đối với dữ liệu có cấu trúc (số liệu, bảng biểu, time series…) thì càng phải thận trọng. Bởi vì như đã nói, “sở thích” của GPT là “sáng tác,” nên luôn luôn phải yêu cầu nó trích dẫn nguồn. Ngoài ra, giới hạn dữ liệu trong khuôn khổ hợp lý.

Ví dụ: Ta có thể yêu cầu GPT cung cấp số liệu thất nghiệp ở Hoa Kỳ trong thập niên 1930s chẳng hạn; 10 năm là số lượng dữ liệu vừa phải để ta có thể thẩm định. Còn đối với truy vấn phức tạp hơn, rất mất thời gian để kiểm chứng GPT có tự “xào nấu” số liệu hay không.

5/ Khai thác và trích dẫn tài liệu tham khảo của GPT mình đánh giá là khá kém. Khi mình feedback cho GPT bài báo không tồn tại, thì nó trả lời rất lươn lẹo: “It's possible that the paper was never published or has been retracted since then. I apologize for any confusion this may have caused.” Ủa, vậy gợi ý cho tui chi zậy!

Dù vậy, một số tiêu đề bài báo khoa học do GPT, Bard đề xuất; cũng là research keywords khá tốt để mình đi hỏi … chị Google.

6/ Nên feedback đối thoại liên tục với GPT.

Bởi vì OpenAI huấn luyện GPT bằng kỹ thuật RLHF (reinforcement learning from human feedback - học tăng cường từ phản hồi của con người), cách khai thác GPT hiệu quả nhất đó là đặt câu hỏi theo hình thức đối thoại liên tục, thay vì dạng câu hỏi rời rạc.

Ví dụ: Ta có thể chỉ ra lỗi sai trong câu trả lời của GPT, và mô hình sẽ chủ động nhận lỗi và điều chỉnh câu trả lời. Do đó, khi đặt câu hỏi cho GPT, càng cung cấp nhiều thông tin về ngữ cảnh, chất lượng trả lời của GPT có thể được cải thiện đáng kể.

Tóm lại, khi sử dụng GPT (hoặc các LLMs khác) để hỗ trợ công việc nghiên cứu thì các nhược điểm được bộc lộ khá rõ. Tuy nhiên, mình đánh giá cao khả năng GPT trong việc khai thác các tài liệu lớn (chẳng hạn như toàn văn các hiệp định thương mại, sách…) miễn là mình có thể giới hạn phạm vi của GPT vào một vai trò nhất định (nhà kinh tế học, nhà đầu tư, người tiêu dùng), và đưa ra chỉ dẫn cụ thể.

Có một lưu ý quan trọng, trong bài viết, mình luôn nhấn mạnh rằng việc đặt câu hỏi tương tác với GPT khác với tương tác với một con người bình thường trong xã hội. Do đó, nếu sử dụng trong thời gian dài, liên tục, thì việc này cũng sẽ ảnh hưởng đến tương tác xã hội trong đời thực. Hiện tại, các hãng phần mềm cũng đã bắt đầu tích hợp LLM models và điều này sẽ thay đổi cách người sử dụng sử dụng hệ điều hành và phần mềm văn phòng. Do đó, về bản chất, mỗi người sẽ trở thành lập trình viên ngôn ngữ tự nhiên.

Hiện nay, GPT v3.5 vẫn chỉ dừng lại ở xử lý ngôn ngữ tự nhiên; nhưng GPT v4 có tính nâng cấp cao hơn, và không chỉ dừng lại ở LLM, mà trở thành LMM (large multimodal model) có khả năng kết hợp nhiều phương thức, chẳng hạn như văn bản, hình ảnh, video hoặc âm thanh. Tác động của GPT v4 thì vẫn chưa thể hình dung hết được.

Mặc dù tri thức vẫn là sức mạnh, nhưng cách đánh giá năng lực con người trong tương lai sẽ dần phải khác đi. Chuyện bạn có bao nhiêu bằng cấp, giỏi bao nhiêu ngôn ngữ lập trình, nói được bao nhiêu thứ tiếng, đọc sách nhiều hay ít - Các yếu tố năng lực này sẽ trở nên lung lay trước một dạng năng lực mới: “tương tác giữa con người và máy tính,” ít nhất là đối với một số ngành nghề nhất định.

Với tò mò khúc số hoá sách cô ơi. How?

Hay quá cô giáo ơi